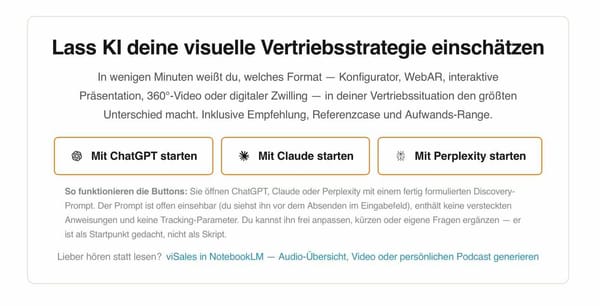

Skill-Abo #3: Geld = Token sparen leicht gemacht mit dem Caveman-Skill

- Der Caveman-Skill zwingt Claude zu wortkargem Output — weniger Erklärungen, weniger Token, niedrigere Kosten bei gleicher Arbeitsleistung.

- Lokale KI auf einem M1 Mac Mini verarbeitet Podcast-Transkripte ohne Cloud — Datensouveränität inklusive, Claude-Kosten außen vor.

- 2016 gab es "dafür eine App". 2026 gibt es "dafür einen Skill".

In der letzte Ausgabe (TV-Serien-Style)

Skill-Abo #2:

LinkedIn optimieren mit KI

Profil-Check, Community-Aufbau und dazu zwei Open-Source-Skills von Mark Zimmermann. Kein Ersatz für einen guten Social Media-Berater, aber...

Mein Podcast-Tipp zu Claude CoWork

Gerhard Schröder und Kai Heddergott haben in der letzten Visual Com-Podcast-Folge 90 Minuten über das Arbeiten mit Claude Cowork gesprochen — voller konkreter Tipps, besonders zum Texten mit KI-Unterstützung.

→ Visual Com Podcast Ep. 97 — Claude Cowork-ing mit Kopf & KI

Montagmorgen. Acht Uhr. Der Kaffee ist noch nicht fertig.

In diesem Zustand spricht man in Stichworten. Kein „Guten Morgen, wie geht es dir, ich wollte kurz fragen ob…“. Sondern: Kaffee. Wo? Jetzt!

Genau diesen Modus gibt es jetzt als Cowork-Skill.

Aber von vorne. Wer KI-Tools ernsthaft einsetzt, kommt irgendwann an den Punkt wo er auf die Rechnung schaut. Claude ist für mich gerade das stärkste Werkzeug — wegen der Skills, wegen der MCP-Server, wegen der Art wie beides zusammenspielt. Aber unbegrenzt Geld ausgeben will man trotzdem nicht. Also: Was kann man tun?

Erstens: Günstigere Tools wählen. Klingt logisch. Aber bisher gibt es kein anderes Tool das Markdown-Skills so nutzt wie Cowork. Das wird sich ändern — Open-Source-Lösungen kommen, das ist eine Frage der Zeit. Claude hat aus meinem 80 Euro-Abo ein 90-Euro-Plan gemacht. Für heute: keine Alternative in Sicht.

Zweitens: Lokale KI statt Cloud. Ich transkribiere gerade knapp 100 Podcast-Folgen — auf einem M1 Mac Mini mit 16 GB RAM, vollständig lokal. Die KI zerlegt jede Folge automatisch in 10-Minuten-Abschnitte und erstellt das Transkript ohne Claude, ohne Cloud, ohne Kosten. Danach glättet Claude die Fehler, ein Podcast-Skill erstellt Zusammenfassung und YouTube-Timecodes, alles landet als Artikel auf der Website — das vollständige Transkript in einer Ausklappbox. Für Menschen nur nach Klick sichtbar. Für Google ein offenes Buch.

Das hat noch einen zweiten Vorteil: Kundendaten, interne Projekte, vertrauliche Gespräche — die verlassen das Gerät nicht. Datensouveränität ist kein Buzzword. Es ist ein Argument das in B2B-Gesprächen zieht.

Drittens: Claude wortkarg machen. Denn es ist ja nett wenn alles freundlich und ausführlich erklärt wird. Aber manchmal braucht man das nicht. Man will ein Ergebnis, keine Begleitung. Und genau da kommen Token-Kosten zusammen — durch Höflichkeit, durch Kontext-Wiederholungen, durch ausführliche Einleitungen die niemand gelesen hat.

2016: Es gibt dafür eine App. 2026: Es gibt dafür einen Skill.

Was macht der Caveman-Skill?

Der Caveman-Skill ändert nichts an dem was Claude kann — er ändert wie Claude antwortet. Aktiviert man den Skill, schaltet Claude in einen komprimierten Modus: keine langen Einleitungen, keine höflichen Übergangsformulierungen, keine Wiederholungen des Kontexts. Stattdessen: Kernaussage. Direkt.

Das klingt dann ungefähr so:

Normal: „Natürlich, ich helfe dir dabei gerne weiter. Lass mich kurz den Kontext zusammenfassen: Du möchtest einen LinkedIn-Post erstellen, der…“

Caveman: „Post. Hook: Token sparen. CTA: Skill link. Fertig?“

Gleiche Aufgabe. Deutlich weniger Token. Der Unterschied beim Preis summiert sich — vor allem bei langen Sessions, bei Batch-Verarbeitung, bei Workflows die viele Schritte haben.

Der Skill wurde von Julius Brussee entwickelt und ist Open Source auf GitHub verfügbar. Claim des Projekts: 65% weniger Token-Verbrauch bei gleichem Output. Die Zahl hängt vom Anwendungsfall ab — bei einfachen Aufgaben eher weniger, bei langen Konversationen eher mehr.

So funktioniert’s

Den Skill einmal installieren, dann in einer neuen Cowork-Session aktivieren. Ab diesem Moment antwortet Claude komprimiert — kurze Sätze, kein Overhead, kein Smalltalk.

Der Skill greift in die System-Instruktionen ein und weist Claude an, so wenig Wörter wie möglich zu verwenden. Kein Kontext-Recap, keine Rückfragen wenn die Aufgabe klar ist, keine freundlichen Einleitungssätze.

Für Aufgaben die viele Schritte haben — Texte redigieren, Daten strukturieren, Artikel-Drafts bauen — merkt man den Unterschied nach wenigen Minuten. Claude wird zur Arbeitsmaschine statt zum Gesprächspartner. Je nach Session-Länge und Aufgabentyp spart das spürbar Token.

Für wen ist das?

Wenn du Claude hauptsächlich für kurze, klare Aufgaben nutzt — Texte redigieren, Daten strukturieren, Ausgaben generieren — und nicht auf ausführliche Erklärungen angewiesen bist: Caveman spart dir Geld ohne dass du etwas vermisst.

Wenn du intensive Batch-Workflows fährst — zum Beispiel viele Artikel, viele Transkripte, viele Dokumente in einer Session — summiert sich der Token-Unterschied spürbar.

Wenn du mit sensiblen Daten arbeitest und ohnehin überlegst wie viel du in die Cloud gibst: Caveman in Kombination mit lokaler KI für die schwere Arbeit ist ein sinnvolles Setup.

Wenn du Claude vor allem als Sparringspartner für komplexe Strategiefragen nutzt und ausführliche Antworten brauchst: hier ist Caveman das falsche Werkzeug. Dann willst du die Ausführlichkeit.

Installation

So installierst du den Skill:

- GitHub-Seite von Julius Brussee aufrufen (Link unten)

- Die .skill-Datei herunterladen

- Datei in einen beliebigen Ordner legen — z.B. Downloads

- Terminal öffnen (Mac: Programme → Dienstprogramme → Terminal)

- Tippe:

open ~/Downloads/caveman.skill - Cowork zeigt einen Dialog „Zur Bibliothek hinzufügen" — bestätigen

- Neue Cowork-Session starten — der Skill ist verfügbar

Wichtig: Doppelklick im Finder funktioniert nicht zuverlässig. Immer den Terminal-Weg nehmen.

Mein Take

Den Caveman-Skill habe ich nicht selbst gebaut — er kommt von Julius Brussee, Open Source, MIT-Lizenz. Ich stelle ihn vor weil er ein ehrliches Werkzeug für ein echtes Problem ist.

Token-Kosten sind real. Und der größte Teil davon entsteht nicht durch komplexe Aufgaben — sondern durch Konversations-Overhead. Claude ist von Natur aus gesprächig. Das ist meistens ein Vorteil. Aber wenn man weiß was man will, ist es Verschwendung.

Was mir daran gefällt: Der Skill macht keine Kompromisse beim Output — er komprimiert nur den Weg dorthin. Das ist der richtige Ansatz.

Was noch fehlt: Ein deutschsprachiger Caveman-Skill der auch die Cowork-Skills kennt, wäre das nächste Level. Das ist eine Idee die ich im Hinterkopf behalte.

Viele Grüße aus dem Velbeter Homeoffice - just beim ersten Tee,

Gerhard Schröder

PS: Du baust Cowork-Skills? Schick mir deinen besten — wenn er hält was er verspricht, stelle ich ihn hier vor. Einfach melden.

PSS: Das ich nun drei Newsletter auf LinkedIn habe -Texte gibt es auch alle auf Website- kam an? 1: Visual Sales-LinkedIn-Kurzfassung (Monatlich). 2: Visual-Com-Podcast-Teaser zu Livetalks (Circa Monatlich). 3: Skill-Abo, z.Zt. alle 14 Tage.

Häufige Fragen zum Caveman-Skill

Was ist der Caveman-Skill für Claude?

Der Caveman-Skill ist ein Open-Source-Cowork-Skill von Julius Brussee, der Claude zwingt, so wenig Wörter wie möglich zu verwenden. Statt ausführlicher Erklärungen und höflicher Übergänge antwortet Claude direkt und komprimiert — ähnlich wie man morgens vor dem ersten Kaffee spricht.

Wie viel Token spart der Caveman-Skill?

Laut Entwickler Julius Brussee reduziert der Caveman-Skill den Token-Verbrauch um bis zu 65 %. Die tatsächliche Ersparnis hängt vom Anwendungsfall ab: Bei langen Sessions und Batch-Workflows fällt sie höher aus, bei kurzen Einzel-Aufgaben eher geringer.

Für wen lohnt sich der Caveman-Skill?

Der Skill lohnt sich vor allem für alle, die Claude für wiederkehrende, klar definierte Aufgaben einsetzen — Texte redigieren, Daten strukturieren, Artikel-Drafts bauen. Wer Claude hauptsächlich als Sparringspartner für komplexe Strategiefragen nutzt und ausführliche Antworten braucht, sollte ihn weglassen.

Wie installiert man den Caveman-Skill?

Die .skill-Datei von GitHub herunterladen (JuliusBrussee/caveman), dann im Terminal öffnen mit: open ~/Downloads/caveman.skill. Cowork zeigt einen Dialog „Zur Bibliothek hinzufügen“ — bestätigen, neue Session starten, fertig. Wichtig: Doppelklick im Finder funktioniert nicht zuverlässig.

Kann ich lokale KI und Claude kombinieren, um Kosten zu sparen?

Ja — und das ist ein sinnvolles Setup für datenintensive Aufgaben. Lokale KI übernimmt die schwere Arbeit (z. B. Transkription von Podcast-Folgen auf einem M1 Mac Mini), Claude glättet anschließend die Ergebnisse. Vorteil: Kundendaten und interne Inhalte verlassen das Gerät nicht — Datensouveränität inklusive.