Die Vorgeschichte zu OpenUSD

OpenUSD wird häufig als weiteres 3D-Format eingeordnet. Genau das ist der Denkfehler. Das eigentliche Problem heutiger 3D-Workflows liegt nicht in Rendering, Performance oder Tools, sondern in der fragmentierten Nutzung derselben CAD-Daten. Für Website, Video, AR, Präsentation oder Simulation werden Inhalte immer wieder neu aufbereitet – mit steigenden Kosten und inkonsistenten Ergebnissen. OpenUSD ist deshalb nicht primär technologisch interessant, sondern strategisch: als gemeinsame Datenstruktur, die diesen permanenten Neubau erstmals überflüssig macht.

Die folgenden Zeilen ordnen OpenUSD jenseits des operativen Alltags ein.

Sie zeigen, warum der Standard entstanden ist, wie er sich entwickelt hat und welche Rolle große Industrieakteure dabei spielen. Wer den strategischen Hintergrund verstehen möchte, findet hier die Zusammenhänge.

Teil 1: OpenUSD für Entscheider

Teil 2: FAQ zu: OpenUSD für Entscheider

Anhang 1: Die Vorgeschichte zu OpenUSD (Dieser Beitrag)

Anhang 2: NVIDIA Omniverse für den Mittelstand

Anhang 3: Warum Apple dem Metaverse näher ist als Meta

OpenUSD in der Praxis: OpenUSD-Dienstleister viSales

OpenUSD-Produkte von viSales: USDconfig & USDbridge

Einstieg in AR & USDZ — mit Unterstützung.

Wir begleiten Unternehmen vom ersten USDZ-Modell bis zum eingebetteten WebAR-Erlebnis — ohne Umweg über IT-Projekte. Mehr als 15 Jahre B2B-Praxis.

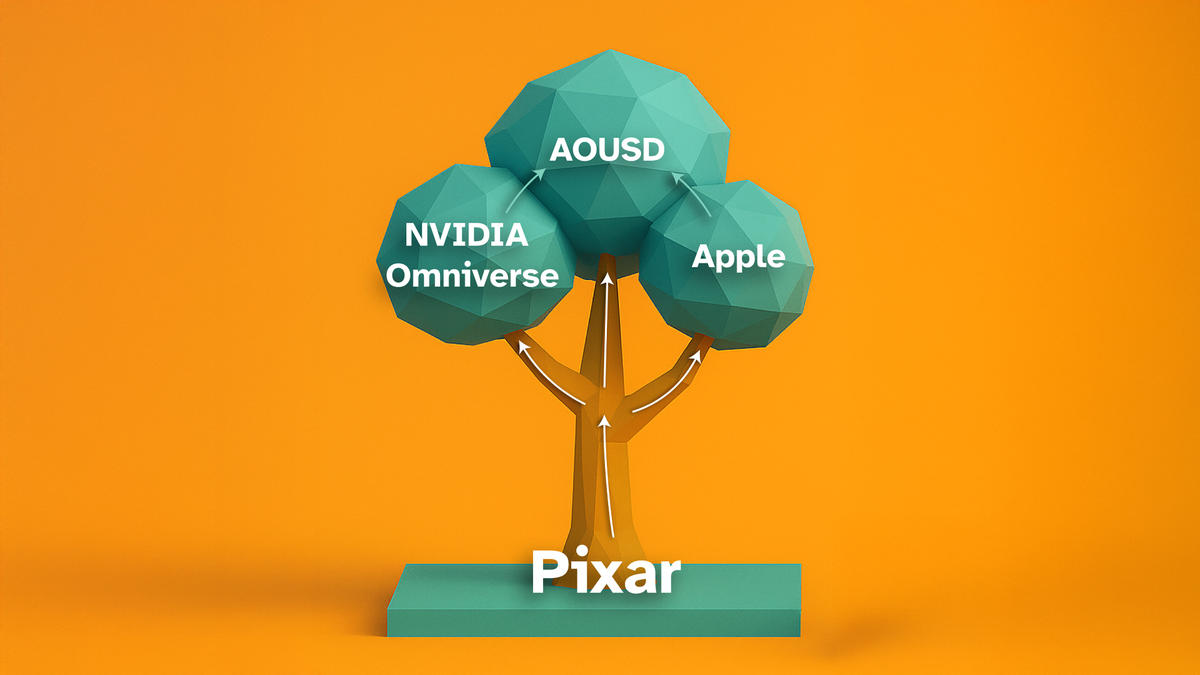

Von Pixar zu OpenUSD:

die historische Entwicklung

USD -später OpenUSD- wurde 2015 von Pixar erstmals öffentlich vorgestellt und 2016 als Open-Source-Projekt freigegeben. Ziel war es, komplexe Filmszenen über viele Abteilungen hinweg konsistent zu organisieren und weiterzuentwickeln.

Von Beginn an unterstützte Apple diesen Ansatz und brachte eigene Erweiterungen in das Projekt ein. Google entschied sich hingegen gegen USD und setzte stattdessen auf das alternative Format glTF der Khronos Group.

NVIDIA begann früh, USD in eine eigene Richtung weiterzuentwickeln und schuf mit Omniverse eine Plattform, die USD stark pipeline- und skriptorientiert nutzt. Diese Erweiterungen waren nicht immer deckungsgleich mit den Vorstellungen von Pixar oder Apple.

So entstanden über die Jahre drei unterschiedliche Ansätze rund um USD.

Industriegeschichte hinter OpenUSD & USDZ

In einem rund 30-minütigen Vortrag wird die Entstehung von OpenUSD und USDZ im industriepolitischen Kontext eingeordnet – von den Ursprüngen bei Pixar über die Rolle von Apple und NVIDIA bis zur Entscheidung des Metaverse Standards Forum, USDZ als Masterformat zu nutzen.

Der Vortrag richtet sich an alle, die den größeren Zusammenhang verstehen möchten: Warum offene 3D-Standards heute strategisch relevant sind, weshalb der Metaverse-Hype an Sichtbarkeit verlor, warum die zugrunde liegenden Standardentscheidungen dennoch weiterwirken und die AR-Story von Apple.

Transkript (KI-bereinigt)

Herzlich willkommen, warum wir hier heute zusammengekommen sind und über eine ganz andere Plattform und einen anderen Ansatz zu reden.

Und zwar ist der Ansatz schon ein bisschen älter. Ich habe mitgebracht für euch drei Geschichten.

Drei kleine Geschichten. Die erste Geschichte hat was mit Iron Man zu tun.

Ihr dürft ihr eine oder andere kennen. Genau aus dem Figur von Marvel.

Das zweite hat mit einem Schiff zu tun. Mit einem sehr alten Schiff.

Und das dritte hat mit Nemo zu tun.

Genau. Und die drei Geschichten passen irgendwie auch alle zusammen.

folgt mir also es war das jahr 2007 oder 2009 ich glaube 2007 dass die marvel studios sich

damals gesagt haben okay nachdem wir die ersten filme haben rausbringen lassen damals als lizenz

sony pictures mit spider-man und dem spider-verse und dann haben gesagt okay das ist alles gut wir

verdienen über die lizenzen geld aber die konnten sich jetzt ausrechnen nach ein paar filmen die

verdienen ja richtig gut. Warum machen wir das nicht selbst? So kamen sie auf die Idee, welchen

unserer Superhelden fangen wir mit an? Ihr könnt es euch ausrechnen. Genau, sie haben jetzt im ersten

eigenen, auf eigene Kasse produzierten Film. Das heißt, sie mussten auch selbst so gesehen mal

tief in die Kasse greifen und entsprechende Vestoren finden. Der erste Film war Iron Man. Und

im Iron Man auf den Weg zu bringen, mussten sie damals nicht nur ein Grafikstudio engagieren,

dass die 3D-Grafik gebaut hat, sondern sie brauchten mehrere Leute von mehreren Teams, von verschiedenen Unternehmen, die alle eins wollten.

In jedem dieser Teams sollte der da gleich aussehen.

Das Thema ist, so sieht er noch ganz simpel und einfach aus, das ist ein 3D-Modell, einfach nur mit Farbe.

Und es hatten die aber damals schon die verschiedenen Unternehmen, verschiedene Software-Systeme im Einsatz.

Die konnten sich einigen auf eine Grundinformation.

Wie sieht das Modell generell aus? Also wie hoch, wie breit? Und welche Farbe haben die einzelnen Elemente? Und dann kam das da. Und da hat jeder für sich gesagt, der eine so, der andere so. Und dann versuchten sie das irgendwie alles ein bisschen untereinander gleich zu bekommen.

Damit hatten sie eines der ersten Probleme des gesamten Metaverse schon mal für sich festgestellt,

in der harten Variante, Interoperabilität.

Nicht nur einfach zu sagen, ich habe ein generelles 3D-Modell,

sondern das 3D-Modell ist egal, bei wem ich es habe, muss am Ende gleich aussehen.

Böse Zungen sollen auch behaupten, dass man im Film Iron Man in verschiedenen Szenen

ein bisschen unterschiedlich aussieht, was so den Glanz ausgeht.

Also muss man irgendwie eine Lösung finden.

Und da haben sie sich dann irgendwann darauf geeinigt, in der heutigen Zeit, der Begriff da unten rechts PBA ist dem einen oder anderen bekannt.

So, aber das war damals noch Zukunft.

Damals mussten die in verschiedenen Software-Systemen einzelne Regeln rumspielen, bis die Szenen referenzmäßig untereinander wieder passten.

Grundproblem eben Interoperabilität und das wollen wir auch fürs Metaverse oder wie auch immer die Kiste in Zukunft heißt.

Also dieser Begriff ist für mich völlig wumper, hat auch nichts mit Meta zu tun, sondern ganz früher haben wir auch Datenautobahn mal gesagt.

Oder das World Wide Web und irgendwann haben wir uns auf Internet geeinigt, dass selbst darüber reden die heute nicht mehr, die reden nur noch, ich nutze WhatsApp.

Der Rest ist den Leuten am Ende ja auch egal.

So, das war das erste Stück. Mal so ein ganz grober Einstieg von einem der Grundprobleme, Interoperabilität.

So, jetzt gibt es diesen Standard OpenUSD, gleich dazu mehr, und der ist in der Verheißung großartig.

Die Realität ist momentan aber eher so wie das da.

Das ist noch ein Kupferstich.

Man kann es vielleicht erkennen, das ist ein Segelschiff mit Schornstein, einer Dampfmaschine und Schaufelrad auf einem großen offenen Ozean.

Kann man sich vorstellen, das ist ein Nischenprodukt.

Denn zur gleichen Zeit ungefähr gab es das hier.

Das war das Größte, das Beste.

Das war der einzige Siebenmaster, der gebaut worden ist.

Ihr kennt das.

Man hat eine Basistechnologie, so was wie ein 1,86, ein 80, 86, dann 2,86, ein 3,86.

Man nimmt das Ding, da kann man noch was dran schrauben.

Und das Geschäftsmodell von denen war zur damaligen Zeit, von solchen Segelschiffen gab es nur noch zwei Modelle.

Das eine war, versuche Fracht von A nach B noch zu bekommen.

Das andere Geschäftsmodell zur gleichen Zeit war, nimm ein großes solches Schiff, packe das voll Steinkohle.

Hier im Ruhrgebiet, ihr wisst, was ich meine.

Packe es voll, schick es mitten auf einem offenen Ozean an eine feste Stelle, ihr wisst, was Ladesäulen sind.

Die haben damals Segelschiffe mit Steinkohle bepackt, um sie mitten auf einem offenen Ozean zu fahren.

Und dann haben sie gewartet. Wisst ihr worauf? Auf die da.

Eine gewisse Zeit, für ein paar Jahrzehnte, war das tatsächlich ein Geschäftsmodell, Segelschiffe zu bauen, sie mit Kohle zu beladen, zu warten, bis die anderen wieder vorbeikommen.

Weil die Schiffe, bei Wind kamen die ja von alleine, von A nach B.

Aber wenn kein Wind war, die konnten nicht genug Kohle bunkern in diesen Schiffen.

Also brauchten die damals, also eine großartige Technologie in der Idee, aber in der Marktnische eigentlich nur noch ein Rohrkrepierer.

Da kamen die nicht so richtig voran.

Zur gleichen Zeit, die gleiche Technologie.

Schaufelrad, Kohle, aber die Tanksäulen am Mississippi, die waren auch regelmäßig,

Und dann war das kein Problem, den Kram von A zu bringen.

Da konnte diese Technologie in dieser Marktnische auf Mississippi gut funktionieren.

Aber auf offenen Ozeanen war das keine gute Lösung.

Also in der richtigen Marktnische, die richtige Technologie, tolle Idee.

Ihr seht die Jahreszahl da unten.

Eigentlich schon ein bisschen früher, 1894.

Das Schiff hat, das war so gesehen, eigentlich der technologische Umbruch.

Das Schiff heißt Turbinia, ist heutzutage tatsächlich im Museum in Kadiff.

Und das Schiff ist von so einem britischen Adligen, einem splienigen Typen.

Der hatte viel Geld.

Der hatte sich zur damaligen Zeit diese Schaufelraddinge angeschaut und hat gesagt,

das muss auch anders gehen.

Das muss effizienter gehen.

Das muss schneller gehen.

Was hat er gemacht?

Keine Schaufelrad.

Schraube.

Effizientere Energieübertragung.

Energieübertragung. Und der Name lässt es fast schon vermuten,

da war nicht nur mit Kolben und langsam und schnaufend, sondern

Turbine. So, und dann gab es damals, ihr kennt das in Hamburg, im Hafen

gibt es einmal im Jahr die große, alle Schiffe und wir machen große

Party. Das gibt es auch in London auf der Thamse, einmal im Jahr.

Und da ist der damals, die anderen mit ihren Segelschiffen, so ein bisschen wie ein Escort,

in den Hut zuwinken, und dann kam der,

brauchst dann allen anderen vorbei.

Das kriegten auch ein paar Leute von der Kriegsmarine mit.

Von der königlichen, britischen Marine.

Die dachten sich, okay, wir haben ein Problem.

Weil zur gleichen Zeit waren so,

eigentlich sahen da Kriegsschiffe noch aus.

Ja, okay, nicht genau das, aber ihr wisst, was ich meine.

Das waren Segelschiffe.

Es gab vielleicht zwei, drei, die hatten dann schon Schaufelrad.

An der Stelle, wo ein Schaufelrad an der Seite ist,

Du kannst aber keine Kanonenseiten ranbauen.

Geht nicht.

Und ihr wisst, wo das Problem an der Stelle jetzt technologisch ist.

Das heißt, innerhalb von 20 Jahren hatte sich die gesamte königliche britische Marine

war mit einmal nicht mehr interessant.

Der technologische oder der mengenmäßige Vorteil an Schiffen, die die Briten hatten,

gegenüber anderen, war von heute auf morgen.

Und wer war damals eine große aufstrebende Wirtschaftsmacht?

Ein gewisses Kaiserreich aus Deutschland.

Denn nur ein paar Jahre später sahen Schiffe mit einmal so aus.

Selbe Basistechnologie, aber eine wichtige Veränderung, sie brauchten keine Masten, gar nichts mehr.

Das heißt, die großen Kanonen, die wir dann später auf Schiffen gefunden haben, auf Kriegschiffen,

die frei rüberschwenken konnten und so weiter, waren vorher gar nicht möglich,

weil da waren Masten und alles im Weg.

und inzwischen aufgrund von, da passt genug Kohle rein,

weil Stahlschiffbau hat sich natürlich auch noch in Veränderung gebracht zum Holzschiff,

außer man hat nur halbhohe Wände innen drin und betrifft Eisberge,

aber das ist eine andere Geschichte.

Aber jedenfalls ist damit der Weg gegeben worden für komplette technologische Veränderungen.

Von der kleinen Nische zu Anfang, Mississippi, innerhalb von wenigen Jahrzehnten

konnte man, als der Rest sich auch weiterentwickelt hat, auch den Rest umbauen.

so damit kommen wir jetzt zu den da süß knuddelig und jetzt kommen wir wieder zurück ich hatte

vorhin den iron man ja da gab es ja verschiedene computer grafik firmen ich glaube die jungs da

oben kennt ihr die mit der kleinen büro lampe so jedenfalls die jungs hatten auch damals für

sich irgendwann mal vor ein paar jahren festgestellt wir wollen auch dieses 3d grundproblem wieder

lösen und haben gesagt okay wir können darauf warten dass irgendeiner was macht oder machen

selbst. Also haben sie sich hingesetzt,

okay, wir wissen, wir haben gewisse Anforderungen.

Wir wollen dieses Thema Interoperabilität

auf jeden Fall für 3D-Dateien

gelöst haben, weil es hilft mir nichts, wenn ich

was in Software A animiere

und in Software B

oder ein anderes Studio,

ich brauche meine Basis, mit der ich

arbeiten kann. Also haben sie sich hingesetzt und

haben gesagt, na gut, wir definieren mal

selbst einen Standard und

irgendwann müssen wir

den Markt kommunizieren. Da gibt es so eine Messe,

die heißt Sieggraf, einmal im Jahr,

das ist wirklich noch eine Leitmesse für eine Szene, für eine Branche.

Und da hat sich jemand dann auf die Bühne gestellt, mit einem kleinen Rechner.

Also nicht riesige technische Aufbauten.

Kam hin, HDMI-Kabel angeschlossen, Rechner aufgeklappt, Textkommandozeile.

Und drei Sekunden später war in Echtzeit gerendert eine Szene von Findet Nemo auf dem Laptop gerendert,

da so gesehen auf dem Beamer.

Man könnte sagen, das war eigentlich so gesehen das Ende schon seiner Präsentation.

Aber eigentlich hat er alles gezeigt.

Er hat gezeigt, dass man auf einer kleinen Maschine ganz viel rausholen kann.

also effizient und dann natürlich hat er das Format auch vorgestellt. Das Dateiformat heißt

eben USDZ. Der Standard heißt inzwischen, hieß damals USD, dummerweise ist USD auch die Abkürzung

für US-Dollar. Ein bisschen suboptimal würde ich gerne sagen an der Stelle. Also hat man daraus

gemacht dann später mal OpenUSD, weil sie haben das Ganze dann auch Open Source gestellt.

Sprung jetzt mal zu meiner eigenen Geschichte, wie das eine mit einem anderen zusammenfasst.

Ich komme auf das andere Thema zurück.

Kann irgendjemand sich noch an die Firma Metagio erinnern?

Okay, wir wollen gerade sagen.

Aber der eine oder andere von euch hat so ein Gerät zur Hand.

Also entweder ist da ein Apfel drauf oder ein kleiner Roboter.

Das ist eigentlich egal.

Gut.

Und ihr wisst, es gibt was wie Augmented Reality, dass man mit einem Handy da was machen kann.

Soweit auch bekannt.

Gut.

2013 gab es in Deutschland eine Firma.

Die hatte damals einen recht guten Kundenkreis in der Automobilbranche schon.

Die hatten einen Augmented Reality Browser komplett entwickelt,

mit dem man 3D-Objekte in der realen Welt einfach so irgendwo hinpacken kann,

übers Handy oder über Tablets.

Komplett fertig.

Manche Leute sagen, so etwas hat man vor kurzem nochmal gesehen.

Die hatten das 2013 schon.

Ich war bei denen zu Besuch.

Ein Foto mit einem Geschäftsführer, von mir die ganze Geschichte erzählte.

hat ja noch, Joano hieß auch deren Browser.

Und die hatten unter anderem ein paar Patente zusammen mit Ericsson entwickelt.

Und eins der Patente umfasste die Idee und die Umsetzung,

Bilderkennung in Form eines Hardware-Prozessors einzubauen.

Dass nicht mehr der normalen Hauptprozessor jetzt zum Beispiel die vielen Punkte vom Markern wiedererkennt,

sondern dass es in der Hardware drin ist.

Falls euch diese Patent-Grundidee irgendwie bekannt vorkommt heutzutage,

Ich würde sagen, die neurale Engine könnte da irgendwie drauf basieren.

Wie gesagt, Ericsson und die.

Und dann wurden sie anderthalb Jahre später gekauft von Apple.

Die hatten damals zwei Softwareentwicklerteams, also ein Team.

Das eine hat für Apple entwickelt, das andere für Android.

Natürlich hat es, nachdem die Firma von Apple gekauft worden ist, haben die Android-Leute sich gesagt, so was machen wir jetzt?

Die kriegten einen Anruf von Google.

haben das Unternehmen gewechselt und waren dann später das Kernteam für eine AR-Ergänzung zu Android.

Die heißt?

AR-Kid.

Und wie heißt die Alternative dazu für Apple?

AR-Kit.

AR-Kit, genau.

Das heißt, eine Kernmannschaft, die Leute kennen sich heute noch,

das sind die Grundlagen für den ganzen Themenbereich AR für diese beiden Software-Systeme.

aus dem Jahre 2013, 2015 aufgekauft.

Die haben innerhalb von ein paar Wochen

natürlich ihre Marketingmitarbeiter und so weiter

alles selber entlassen,

haben ihren ganzen großen Kunden

aus der Mobilbranche angerufen,

haben gesagt,

zirp, zirp, zirp,

sorry, mit euch werden wir jetzt nicht mehr weiter arbeiten.

Zwei Jahre später

hat dann Apple angefangen,

seine eigene Augmented Reality-Lösung vorzustellen.

Damals für Sandy die erste Geschichte.

Zwei Jahre später,

das ist eigentlich der übliche Zyklus,

Apple kauft irgendein Startup auf und du kannst eigentlich sagen, zwei Jahre später kommt was von denen.

Irgendwie ins Betriebssystem, in der Hardware oder wie auch immer.

2017, hier im Apple Store in Oberhausen, kennt ihr auch.

Ich ging da rein und ich war geflasht.

Ich dachte, damals hatte ich zwar schon das Buch mit dem Metaverse gelesen,

aber da habe ich jetzt nicht dran gedacht, aber dass 3D-Daten und Objekte über den ganzen Stadt,

Das war eine Videosequenz, eine Animation.

Über alles rundherum fliegen.

Ich dachte, bin ich ein Blade Runner?

Nein, ich bin nur im Apple Store und sehe da eine Vision des Metaverse von Apple aus dem Jahre 2017.

2020.

Auf der Entwicklerkonferenz, die ja vor vier Jahren, muss man sagen,

vor vier Jahren hat dann Apple im Rahmen der State of the Union,

Es gibt ja die normale Präsentation, die normale Keynote.

Und direkt danach gibt es nochmal eine zweite Keynote.

So gesehen, das eine war für jedermann.

Jetzt gehen wir technisch ein bisschen ins Detail rein.

Das ist State of the Union. Die gibt es immer danach.

Genau, für Entwickler.

Und da haben sie unter anderem dieses Bild, das war eine kurze Videosequenz, gezeigt.

Und jetzt sieht man, hier steht eine Person.

und man sieht die Blickrichtung, das ist so die Kameraperspektive.

Und die Kameraperspektive wiederum sieht diese ganzen Punkte,

weil aufgrund von den ganzen Daten, die Apple gesammelt hat,

ihr wisst alle, es gibt Google Street View und es gibt auch von Apple dieselben Autos,

also gibt es ja auch nochmal von ein paar anderen Kartenanbietern.

Nachdem damals Google das erste Mal durch Deutschlands Straßen gefahren ist

und der große Aufschrei war und sich Leute haben verpixeln lassen und so weiter,

Vier Monate später nach diesem ganzen Aufschrei ist Apple durchgefahren und ein paar Wochen später noch ein weiterer Anbieter.

Das hat schon keinen mehr interessiert, aber am ersten haben sie alle darüber gejault.

Kleinigkeit am Rande.

Jedenfalls, mit diesen ganzen Daten und weiteren freigegebenen Fotos und ähnliches,

hat Apple überall solche Punktewolken für sich erstellt und kann so gesehen,

wenn du das Handy ziehst, erst mal GPS, sagt er erst mal, wo ich ungefähr bin.

Und mit den Daten sagt er dir ganz genau, wo du hinschaust.

Diese Funktion, die Sie da vorgestellt haben, heißt AR Cloud.

Ist in der US-Beta, war damals 2020 bei 20 US-amerikanischen Städten und London.

Und Sie haben vor zwei Jahren, diese Funktion nennt sich dann Location Anchor,

dass du einfach, ihr habt es eben in der Apple Vision Pro ausprobiert,

irgendein Objekt irgendwo hinstellst.

Stellt euch vor, das weltweit.

Und da seht ihr die Liste, in welchen Städten es jetzt auch noch geht.

Bis heute, ich glaube, Paris soll jetzt zufällig neu kommen oder ist, glaube ich, auch mit dazugekommen.

Würde Sinn machen, weil ihr wisst alle, was demnächst in Paris passiert.

Darum habe ich im letzten Newsletter auch so viel auf Paris rumgeritten.

Was für ein besseres Medienereignis kannst du dir noch wünschen?

Leben und steigen.

Gut. Welches Medienereignis kannst du dir noch wünschen, außer als Apple zu sagen, wenn ich mein eigenes Metaverse launchen möchte, außer nebenbei, wir machen das galant mal da nebenbei.

Wer von euch Apple Maps nutzt und durch die Straße geht und die Turn-by-Turn-Funktion nutzt, dann seid ihr eigentlich da schon sehr dicht dran.

Apple hat gerade auf seiner Entwicklerkonferenz die Wanderrouten-Funktion vorgestellt, dass man persönlich Wanderrouten erstellen kann, auch mit anderen Leuten teilen kann.

Diese Daten werden ja in der Cloud gespeichert. Das sind Geodaten in Paketen. Das ist eigentlich auch schon ein Stück von dem da.

Und das geht dann jetzt schon weltweit.

So, jetzt die Frage, was überhaupt ist USD?

Ihr kennt alle HTML, gehe ich von aus, das habt ihr schon mal von gehört.

Man könnte sagen, das Internet basiert ja auf HTML, den Rest wie JavaScript und was,

lassen wir jetzt mal einfach außen vor.

Damals, als wir noch mit Akustikkoppler gab es HTML und da waren wir glücklich zufrieden.

Da gab es damals eine Software nach Mosaik, danach gab es Netzcape Navigator.

Der Netscape-Navigator war in der Lage, als Browser, konnte ich damit eine Internetseite aufrufen, mir anschauen,

war aber auch mein HTML-Editor.

Ich hatte also gesehen, ein Datenformat, ich habe eine Software zum Editieren gehabt

und dann später, wisst ihr alle, kam Windows mit seinem eigenen Browser

und heutzutage gibt es Chrome, es gibt Safari, Chaka und so weiter und so fort.

Es gibt von Adobe Software heutzutage, mit der man Webseiten gestalten kann und ganz viele andere Systeme.

Viele sagen, ich habe gar keinen Bock mehr zu gestalten, ich nehme einfach nur ein WordPress und ein Template.

Egal, aber ihr wisst, was ich meine.

Ich habe so gesehen ein Dateiformat, ich habe irgendwas zum Editieren und ich habe was zum Anschauen.

So, nehmen wir die drei mal zusammen.

Ihr wisst alle, es gibt Unity und Unreal.

Das sind so gesehen, einfach gesagt, es ist ein Stück Game Engine.

Und dazu gibt es entsprechend auch gleich eine Editierfunktion in der Software und am Ende kann ich Ihnen irgendwas ausgeben.

Alles von einem Hersteller.

So ähnlich wie damals von Netscape, Navigator, einer für alles.

Vor- oder Nachteil ist, es ist ein integriertes System, das ist super.

Nachteil ist, beides sind börsennotierte amerikanische Unternehmen.

Die haben zwar teilweise Sachen Open Source gestellt,

aber wer sich in letzter Zeit mit dem Lizenzthema beschäftigt hat,

die haben vor kurzem ihre Lizenzpreisemodelle ganz...

Sie können einfach mal, es ist ein Unternehmen, das sagen kann, ich muss meine Rechnung bezahlen können.

Genau, so. Also das hat alles Vor- und Nachteile, so ein System zu nutzen.

So, jetzt eine Frage, gibt es denn was von RatioFarm? Gibt es ein Linux, so gesehen? Gibt es einen Blender?

Und ja, das gibt es.

Das ist OpenUSD.

Jetzt muss man sagen, Moment, was willst du mir damit sagen?

Naja, es gibt verschiedene Software-Systeme, mit denen ich sowas editieren, verarbeiten kann.

Und es gibt verschiedene, ich nenne es jetzt mal USD-Player.

Einer von diesen USD-Playern ist auf dem Ding drauf.

Das ist im Betriebssystem gleich schon drin.

Jedenfalls, wenn es von Apple ist.

Android ist da an der Stelle raus, aber da komme ich gleich nochmal zu.

Aber das Grundprinzip ist, es ist eine Open-Source-Grundlage, mit der ich arbeiten kann.

Ich kann theoretisch auch mit einer Open-Source-Software wie Blender generell 3D-Objekte erstellen und editieren.

Und ich kann mit verschiedenen Systemen auch das Ganze wiedergeben.

Eins davon dieser Wiedergabesysteme, einer dieser Player-Systeme ist von Apple, aber es gibt auch andere.

Wer das Stichwort von Nvidia, das Omniverse als Begriff schon mal gehört hat, zum Beispiel, ist auch ein weiterer Player für solche Inhalte.

Mir geht es nur um, was die Grundlage ist. Das ist also ein Dateisystem. Es gibt nicht ein einzelnes integriertes, so schönes System wie hier jetzt, momentan.

Ja gut, ihr erinnert euch als Beispiel eben mit dem Dampfschiff. Zur richtigen Zeit das Richtige und Editoren aufbohren und Ähnliches und Standards erweitern braucht Zeit.

Ihr wisst ja aber, erstmal sind wir eben auf Mississippi.

Dann die ganze Welt.

Jetzt hatte ich ja eben schon gesagt, die Kollegen von Google haben sich gesagt,

das ist ja alles schön, also was ist erstmal die Grundlage, was wollten die?

Ich komme jetzt mal zu dazu im Motto, was kann GLTF, was kann der Standard von Google?

Und dann kommen wir dazu, was kann OpenUSD an der anderen Stelle nochmal so on top?

Also Grundlagen, erstmal wie sieht ein 3D-Objekt aus?

Brauche ich eigentlich so kaum nicht so richtig erzählen.

Da habe ich dann Oberflächen drauf und dann habe ich da weitere Angaben, damit es noch schöner wird.

Ganz simpel gesagt.

So, das können die erstmal so gesehen.

Beide.

Da oben haben wir wieder dieses PBA.

Ich sagte ja eben, wie beim Ironman, damit es schöner wird.

Erstmal allgemein.

An der einen oder anderen Stelle.

Genau, aber das erstmal ist so gesehen das, was GLTF kann.

GLTF ist dafür gedacht, dass sich auf dem Smartphone ein Produkt wie ein Ikea-Regal oder Schrank

oder ähnliche Sachen erstmal darstellen kann. Punkt. Und zwar Ansatz Smartphone. Ende.

Die haben gar nicht den Hintergrund, die Idee zu sagen, das soll auch für andere Zwecke,

wie zum Beispiel Pixar, Computeranimation, Filme oder ähnliches sein oder für Industrieanwendungen und so weiter und so fort.

Die hatten Diskussionen dazu vor einiger Zeit und haben gesagt, nö, diese ganze Geschichte von anderen Dingen rundherum

wollen wir nicht in diesem Standard drin haben.

So, jetzt kommen wir zum Thema Apple.

Genau, also wie du schon eben gesagt hast, an der Stelle zu der damaligen Zeit,

als diese Präsentation war, gab es Gespräche zwischen Apple, Google und anderen.

Und Google hat ganz klar gesagt, nee, wir bringen jetzt was Eigenes raus,

weil wir wollen auch was anderes eben damit erreichen.

Mobiltelefone und zwar only.

und wir möchten auf jeden Fall,

die Grundlage für Google ist ja nicht ein Android-Handy.

Die technologische Grundlage für Google ist der Browser, Chrome.

Dass da unten drunter zum Android ist, ist eine Möglichkeit,

aber du kannst es auch auf einem Rechner nutzen,

du kannst es auch auf einem Tablet nutzen, wie auch immer.

Chrome ist die technologische Ebene, auf die sie sich eigentlich bewegen.

Und mit Chrome bedeutet es, dass ich auch immer Webseiten, JavaScript und Google Analytics

drin habe in der gesamten Thematik, damit die wiederum Daten für ihre Werbenetzwerke

haben.

Die wollen nicht nur wissen, irgendjemand hat ein Ikea-Regal in AR als Datei aufgerufen,

das ist das, was Apple maximal weiß, aber was du mit dem Objekt gemacht hast, kann Apple

dir alles nicht mehr sagen, weil Privatsphäre läuft auf dem Gerät.

Google sagt, ich möchte bei jeder einzelnen Interaktion, die mit diesem Produkt, dieser

E-R-Datei passieren, Notfall als Information wieder zurückbekommen für die Werbenetzwerkauswertung.

Also die logische Unterscheidungsanstelle, will ich Privatsphäre auf der einen Seite

oder möchte ich Daten haben auf der anderen Seite?

Und dann ist die Unterscheidung, welchen Qualitätsanspruch habe ich an der Stelle?

Da sagt GLTF, Handy-Darstellung, um einen Verkaufsvorgang mal schnell irgendwas zu visualisieren, reicht uns.

Und in der anderen Richtung sagen sie, wir wollen aber alles weiter können bis zu einem, es muss für Kinofilme reichen.

Auch können, als Grundidee.

GLTF sagt, danke, reicht uns.

Die kleine Lösung.

Und dann sagt eben Apple, wir könnten doch eigentlich, was wäre, wenn wir auch interaktive Inhalte auch in die Datei mit reinpacken.

Darum heißt das Ganze auch USDZ.

Z steht für ZIP, weil das Ganze ist im Prinzip ein Containerformat.

Das heißt, in einem ZIP-File hast du lauter verschiedene Blöcke an Informationen drin.

Erstmal so sieht das 3D-Objekt aus, dann vielleicht Informationen, wie sieht es im Renderer 1 aus

und meinetwegen noch im Renderer 2 oder dieses oder jenes.

Oder die berühmte Wenn-Dann-Maschine ist auch mit drin.

Ich will sagen, ich habe in der Datei auch alles in einem ZIP-File drin, was meine Programmierung darstellt.

Das heißt, ich schicke an mein Gerät eine einzelne ZIP-Datei, komplett runtergeladen, wird entpackt.

Da ist meine Programmierung, alles drin. Es gehen keine Informationen mehr zurück an Apple oder an Google.

Hier ist die Datei, ab jetzt machst du damit.

So, und was natürlich dann auch geht, ich habe nachher auch ein paar kleine Beispiele zum Ausprobieren dabei.

Es geht auch so etwas wie Multi-Objekt AR.

Das heißt, ihr habt es ja vorhin ausprobiert mit der Apple Vision Pro.

Du kannst irgendwas da hinstellen, kannst irgendwas da.

Das geht auch auf dem Handy.

Schon seit Jahren bei Apple.

Android, nur durch die Brust ins Auge Sachen extra programmiert und so weiter und so fort.

Ganz anderer Ansatz, weil die einen einfach sagen, uns reicht das.

So, jetzt kommen wir zum Thema, was macht Apple eigentlich da genau anders?

Normalerweise machst du jetzt mit Unity, Android auch immer, was für ein System.

Du machst eine App.

eine app besteht aus 3d daten die logik und die wenn dann maschine und du hast

eine 3d engine leichter und das heißt du kompiliert eine unity oder unreal app und

da ist ja die 3d engine in der app drin die braucht so und so viel 100 megabyte

gigabyte wie auch immer speicherplatz von deinem handy selbst wenn du jetzt ein

zweites spiel auf deinem smartphone haben solltest dass die gleiche engine nutzt

dann hast du das ganze Ding aber als Paket noch mal daneben genauso.

Du hast zwei oder drei oder viermal oder natürlich noch eine Unreal und so weiter

und du kannst auch nichts untereinander.

Es sind lauter einzelne senkrechte Säulen für sich.

Unten drunter immer ein Betriebssystem.

Der Standardweg, den kennt der eine oder andere von euch sowieso schon seit Jahren.

Der andere Weg ist der Weg, den vor allen Dingen Android erstmal an der Stelle geht,

ist zu sagen, okay, ich habe eine Web-App-Lösung.

Das bedeutet, ich habe ganz unten ein Betriebssystem.

Check.

Darüber habe ich einen Browser.

Klassisch Chrome.

So, und für jeden Einsatz, wann immer ich dieses Ding starten will,

zum Beispiel mein Ikea-Regal oder irgendwas anderes,

muss ich jedes Mal den Rest runterladen.

Also im Sinne von Datentraffic, Energieeffizienz und was auch immer,

ist das nicht gerade die beste Lösung.

Ich habe zwar nicht meinen Speicher komplett voll,

weil ich 20 Mal eine Game Engine auf dem Handy habe, aber ich muss jedes Mal ein Kram runterladen.

Und die Lösung ist nicht so performant wie das da.

Frage von Apple, was macht Apple an der Stelle?

Die haben sich, erinnert euch, ich habe vorhin gesprochen von diesem Unternehmen aus München und so,

das ist daraus entstanden.

Das heißt AR Quick Look.

Gibt es seit vielen Jahren von Apple und ist die Kerntechnologie für alles weitere.

Das heißt, die haben im Betriebssystem die 3D Engine gleich eingebaut.

Die kann nicht all das, was jetzt Unity oder Unreal kann.

Aber ich sage mal so schön für den Hausgebrauch,

für das, was man, die berühmte 80-20-Regel,

für 80% der Anwendung tut das eigentlich erstmal auch schon.

Für den Rest, okay, dann musst du vielleicht mal auf etwas Besonderes begreifen.

Aber für den Regelfall tut das schon, was die hier drin haben.

Und ich muss jetzt nur noch eine kleine Datei runterladen, diese USDZ-Data, das ist der Fall.

Das besteht aus 3D-Datenlogik, wird auf dem Handy einmal ausgepackt

und alles andere habe ich ja schon im Betriebssystem.

Das ist der Weg, den Apple geht und sagt, so bin ich auch, was das Thema,

in Deutschland sollte es ja keine Funklöcher geben.

Was Datenbandbreite angeht und Ähnliches, ich mache alles weitere auf dem Handy.

Oder auf meinem Tablet, auf meinem MacBook oder auf einer Vision Pro.

Das ist die Grundidee an der Stelle, warum Apple gesagt hat,

okay, unser Player für USDZ-Inhalte ist an der Stelle AR Quick Look.

So, wer möchte, ich habe so ein paar Beispiele, jetzt Handy zücken, kann man einfach einen QR-Code einscannen.

Das ist eine einfache Demo, die besteht aus einem Sofa, einem Sessel und einem Hocker.

Kann man dann entsprechend selber jetzt ausprobieren.

Und dann habt ihr drei einzelne Objekte, die ihr einfach mit dem Finger im Raum hin und her stellen könnt.

Bitte nicht draufsetzen, geht nicht. Schon klar, zur Sicherheit.

So, wer es ein bisschen komplexer haben möchte, einen kompletten Bürostuhlkonfigurator.

35 Megabyte, 150 Stoffe, alles drin.

Alles in einer Datei, direkt runterladen.

Da kann Google nicht hinterher sagen, aber wer hat welche Stoffvariante genau wie sich angeschaut.

weil Datei, Ende.

Gibt es auch alles als YouTube-Videos von mir,

sich zum Einzelnen anschauen.

Das ist jetzt ja nichts Neuartiges.

Darum überspringe ich das jetzt mal so ein bisschen.

Weil ich glaube, die meisten von euch kennen die Geschichten.

So, klar, natürlich kannst du auch mehr Bling-Bling machen.

Ich sag mal, die Oberfläche, die Texturen schöner gestalten.

Hier so ein einfaches Beispiel.

Dann glänzt das Ganze.

Und das ganze Ding ist 17 Megabyte groß.

So, und das hier ist eine Geschichte, die wir für Siemens gemacht haben.

Wird genutzt im Verkauf.

Das wird genutzt auf Präsentationen, teilweise auf der Bühne,

statt einfach nur eine PowerPoint-Präsentation aufzumachen.

Bildschirmfreigabe, also Shareplay,

und dann entsprechend einfach auf der Bühne so gesehen,

die Maschine hinstellen und der Präsentator geht um die Maschine rum

und kann so gesehen die Idee, in dem Fall geht es ja nicht um die Maschine,

sondern es geht darum, hier wandern Daten in eine Cloud-Lösung und über die wird eigentlich gesprochen.

Die Maschine oder die verschiedenen Geräte sind einfach nur der Einstieg ins Verkaufsgespräch.

Kommt jemand von der Verpackungsmaschinenindustrie, steht da ein anderes Gerät.

Kommt jemand, wie hier von dem Bereich, ich möchte ein Blech pressen, kommt die Maschine aufs iPad und wird gezeigt.

Ist nur der Einstieg ins Verkaufsgespräch.

So, das war es so gesehen von mir zum Themenbereich. Was ist das Ganze und wofür soll das eigentlich gut sein?

→ Alternative: Die OpenUSD-Story (ca. 30 Min)

Metaverse Standards Forum & OpenUSD / USDZ

Mit dem Aufkommen des Metaverse-Diskurses ab etwa 2021 entstand das Metaverse Standards Forum als branchenübergreifende Initiative. Ziel war es, Grundlagen für interoperable 3D-Inhalte, virtuelle Umgebungen und digitale Güter zu definieren – jenseits einzelner Plattformen oder Anbieter.

Relativ früh legte das Forum dabei eine zentrale technische Leitlinie fest: USDZ sollte als primäres Master-Distribution-/Austauschformat dienen. Andere Formate – etwa glTF bzw. GLB – sollten, wo erforderlich, aus dieser USDZ-Basis abgeleitet werden.

Diese Entscheidung ist bemerkenswert, da sie einen gemeinsamen Nenner zwischen sehr unterschiedlichen Akteuren schuf. Selbst Unternehmen wie Google, die zuvor klar auf glTF gesetzt hatten, akzeptierten damit USDZ als übergeordnetes Austausch- und Masterformat innerhalb des Forums.

Damit wurde USDZ faktisch zur strukturellen Basis dieser Metaverse-Organisation – nicht als Marketingformat, sondern als technisch geeignetes Distributions- und Austauschformat auf Grundlage von OpenUSD.

Parallel dazu entwickelte sich OpenUSD unabhängig vom Metaverse-Narrativ weiter. Während das Forum versuchte, Nutzungsszenarien und Interoperabilität auf Anwendungsebene zu diskutieren, blieb OpenUSD bewusst auf der Fundament-Ebene: Struktur, Referenzierung und langfristige Nutzbarkeit von 3D-Daten.

Rückblickend zeigt sich: Der Metaverse-Diskurs mag an Sichtbarkeit verloren haben – die dabei getroffenen Standardentscheidungen wirken jedoch weiter. Die Wahl von USDZ als Masterformat unterstreicht, warum OpenUSD-basierte Formate heute eine zentrale Rolle in industrieübergreifenden 3D-Strategien spielen.

AOUSD: Ausweg aus dem

OpenUSD-Format-Wirrwarr

Diese Fragmentierung der drei Wege (Pixar, Apple & NVIDIA) führte 2023 zur Gründung der Alliance for OpenUSD (AOUSD). Im Zuge dessen wurde USD offiziell in OpenUSD umbenannt – auch, um Verwechslungen mit der Abkürzung für den US-Dollar zu vermeiden.

Mit der AOUSD wurden die Rechte von Pixar abgegeben und in die Verantwortung der Linux Foundation überführt. Damit wurde die Grundlage für die Neutralität von OpenUSD als branchenübergreifendem Standard geschaffen.

Die AOUSD wurde gegründet, um OpenUSD vollständig von einzelnen Unternehmensinteressen zu lösen und einen gemeinsamen Ausweg aus konkurrierenden Format- und Plattformansätzen zu schaffen.

2023 wurde ein mehrjähriger Vereinheitlichungsplan aufgesetzt. Am 17.12.2025 wurde die Core-Spezifikation 1.0 veröffentlicht. Eine zentrale Aufgabe der AOUSD ist es, diese Spezifikation zu einem IEEE-Standard weiterzuführen. Der entsprechende Prozess soll 2026 abgeschlossen werden.

Parallel dazu werden innerhalb der AOUSD bereits weitere Erweiterungen diskutiert. Dazu zählen unter anderem:

- das dynamische Nachladen von USD-Inhalten,

- BIM-Integration,

- sowie Gaussian Splats als mögliche Bestandteile zukünftiger Core-Versionen (1.x).

Der AOUSD gehören heute zahlreiche Industrieunternehmen weltweit an, darunter Siemens, BMW, Mercedes‑Benz, viele internationale 3D-Softwareanbieter – und bereits früh auch die Agentur viSales aus Bochum.

Transkript (KI-bereinigt)

Gefühle. In and out kommt demnächst ins Kino, zweiter Teil. Ich frage mal jetzt, wie ist eure

Gefühlslage zu dem OpenUSD-Thema? Ich frage nachher dann nochmal. Also überlegt euch, wie jetzt

der aktuelle Screen ist. Genau. Gerd hat jetzt über die Vergangenheit gesprochen.

aktuell und in die zukunft gibt es eine eine roadmap dass das usd ist ja nicht nur ein

datei format sondern programmier bibliothek dass dann zufällig auch seine szenen als ein

datei format abspeichert ist also ein sogenanntes natives datei format und kein generisches es

Es gibt viele 3D-Dateiformate, die möchten möglichst wenig gemeinsame Nenner mit verschiedenen Programmen haben.

Die wollen möglichst offen sein, können dann aber auch nicht, nicht viel.

Und die nativen Dateiformate, die versuchen es, genau ihre tollen Sachen auch so abzuspeichern,

damit sie sie wieder beim nächsten Reihenladen auch wieder haben.

Aber das ist möglichst geheim.

Deswegen native Dateiformate oder generische.

OpenOSD wird halt als Open Source Software in der Öffentlichkeit weiterentwickelt.

Also es gibt die Apache Software Organisation.

Vielleicht kennt jemand den Apache Server.

Der ist maßgeblich von denen mitentwickelt worden.

gehört mit zum Linux Open Source Universum.

Und die haben sich bei sehr vielen Open Source Projekten,

die mit Bilderzeugung und Film und sowas zu tun haben,

die haben sich auch um OpenUSD gekümmert.

Und jetzt gibt es eine neue Organisation,

das ist die Allianz für OpenUSD.

und die wurde gegründet, um die Standardisierung voranzutreiben.

Denn erst bei einer Standardisierung kann man auch Industriepartner davon überzeugen,

dass sie das unterstützen sollen.

Gerd hat vorhin erzählt, dass in einer USDZ-Datei die verschiedenen Renderer

Renderer oder die Programme, die dann die Bilder erzeugen, ihre unterschiedlichen Informationen alle mit ablegen können.

Das unterscheidet es von zum Beispiel dem GLTF-Format, was dann nur eine einzige Information drin hat

und auch nur eine einzige Art der Tessellierung oder wie viele Polygone in einem Mesh drin sind.

Bei USD ist es entweder auch so oder aber es ist ein Authoring-Format.

Also ein Format, was nicht zur superschnellen Ausspielung in einem Webbrowser gedacht ist, wie GLTF,

sondern es ist dafür gedacht, möglichst viele Informationen, die darüber hinausgehen, auch mit abzuspeichern.

Es gibt USD-Dateien, die sind ganz schlank und nur optimiert für einen Zweck.

Und es gibt USD-Dateien, die haben viele Informationen, um zum Beispiel verschiedene Sichtweisen, verschiedene Abteilungen zu befriedigen,

die alle ihre Informationen in einer zentralen Datei abgespeichert wissen wollen.

Das ist die eine Information. Wenn ich also Metadaten, die für den Verkauf relevant sind,

auch noch fünf Jahre später haben möchte, dann kann ich die mit in eine USD-Datei rein speichern,

weil das Dateiformat dafür geeignet ist. Für GLTF muss ich eine neue Extension bauen und

Und irgendeiner sagt dann in der Kronos Group, wer braucht denn das? Das lassen wir lieber weg.

Im Browser macht das nicht viel Sinn.

Da sind ganz viele Sachen blockiert worden.

Gerd hat das vorhin auch schon gesagt.

Schöne smoothen Oberflächen, die aus dem CAD kommen, blockiert.

Wollen Sie nicht, weil das größere Dateien macht.

In USD geht beides.

Ich kann die Daten da rein speichern oder ich kann eine verschlankte Version haben.

Alles, was in Richtung geht, abteilungsübergreifend und alles, was in die Richtung geht, zukunftsorientiert.

Hardware, leistungsfähige Geräte können schönere Oberflächen machen.

Die müssen nicht grobe Meshes behalten, damit es auch noch auf dem 5 Jahre alten Android-Handy funktioniert.

Diesen Monat fängt Apple an, Subdivision-Surfaces reinzubringen.

Eigenes Thema.

Bei USD gibt es den Grundbegriff Stage, das englische Wort für Bühne.

und dieser Begriff kommt halt aus dem Filmbereich, weil auch dieses Denken aus dem Filmbereich herauskommt.

Diese Stage wird gefüllt mit einzelnen Komponenten und das wird alles Prim genannt, Abkürzung für Primitiv.

Primitive. Also alles baut sich wie so eine Art Lego-Bausteine auf und das Konzept ist so gebaut,

dass du auch Metadaten, mit denen nur du was anfangen kannst, trotzdem hinein speichern kannst,

wenn du es dann veröffentlichst und sagst, ja, ich speichere da meine Bestellnummer mit ab,

unter dem Feldnamen sowieso.

Dann kann das jeder dann auch benutzen.

Diese Information kann mit hineingepackt werden,

weil alle Datentypen möglich sind.

Wenn ich das mit einer GLDF-Datei mache,

muss ich eine neue Standardisierung erstmal in Gang bringen

und dann kommen eben die Stimmen, die sagen,

ja, wer braucht denn das?

Ach, Ikea.

Okay, vielleicht, aber...

wie viele Jahre hat das jetzt gedauert, okay, ich lese es mal vor,

haben die verschiedenen Abteilungen, die bei der Filmproduktion mitwirken,

alle ihre eigenen Datenpakete mit hineingepackt.

Das ist zum Beispiel die Effekte, das Rigging, da werden Charaktere mit einem Skelett versehen,

Shading, das ist Materialoberflächen und Geometry. Das sind alles einzelne Datenpakete, die zum

Beispiel bei Augmented Reality zum größten Teil auch wieder Sinn machen. Wir brauchen Rigging für

Skelette. Wir brauchen Shading für Materialien. Wir brauchen Geometrie, eventuell sogar verschiedene

Polygon-Meshes oder Subdivision-Surfaces parallel abgelegt.

Das ist die eine Sichtweise.

Ich kann also viele Datenpakete drin verwalten, verträgt es.

Was aber selten, was viele nicht so wissen, ist, dass man aber auch verschiedene Sichtweisen mit hineinbringen kann.

Diese Layer, diese Schichten haben auch damit zu tun, dass ich auf diese Container oder auf diese Primitiven auch unterschiedlich einwirken kann.

Sie unterschiedlich aktivieren oder deaktivieren kann.

Das sind verschiedene Sichtweisen.

Ich kann die ein und dieselbe Datei reinladen und sagen, ich möchte aber die ganze Szene haben, aber der Stuhl, der soll 5 cm nach rechts.

Dann speichere ich das nicht als Version 25 ab, was dann nochmal 25 GB oder so Speicherplatz kostet.

Und ich verstehe nachher nicht mehr, welche Datei war das jetzt? Versionskontrolle?

sondern das ist nur die Sichtweise, die der Regisseur hatte für die Kameraeinstellung Nummer 18.

Da wäre es besser, wenn es 5 cm woanders ist.

Die Originaldatei bleibt bestehen, aber diese eine Sichtweise wird überschrieben.

Und das kann ich genauso gut abteilungsübergreifend machen.

Modellpflege.

Oder ich habe dasselbe Produkt, nur in 25 Plastikfarben. Dann habe ich die eine Geometrie, aber 25 Materialien.

Greifen alle aufeinander zu und hocheffizient. Nur dadurch kommt das zustande, dass da diese riesige Szene in drei Sekunden geladen war und interaktiv begehbar.

Das war kein Film abspielen, sondern es war eine interaktiv begehbare Szene.

Die Organisation der Allianz für OpenUSD.

wurde gegründet von so großen firmen wie wie die apple

adobe autodesk gleich in der ersten woche kam noch ikea hin hin hinzu nach

vielen jahren wo sie gesagt haben wir haben ganz viele ganz viele fragen und

wünsche an apple gestellt und die haben dann nicht so schnell gesagt sondern die

haben eine große timeline also ein längeres projekt wir machen geld und auf einmal das ist

jetzt richtig das wird jetzt das wird jetzt richtig was und ich ja es mit dabei jetzt vom

paar wochen siemens das so die großen die crd hersteller haben es kapiert wo sie viele jahre

dann gesagt haben, ja unser natives Dateiformat, ja CAD, es gibt nur einen Hersteller, der nicht so ganz Fisch und Fleisch ist mit einem Produkt, Firma Autodesk.

Ganz groß mit dabei bei USD, außer ein einziges Produkt, FRED.

Fred ist ein Spezialprodukt in Deutschland entwickelt und dann aufgekauft.

Nur für Automobilvisualisierung.

Da ist es super.

Aber wehe, USD kann das auch.

Das kann es nämlich.

Mit Omniverse und High-End Grafikkarten werden die arbeitslos.

Also die Großen haben sich jetzt zusammengefügt, um zu standardisieren und gemeinsam Pflege zu machen und zu wachsen.

Warum wollen sie das standardisieren?

Wenn man einen weltweiten Standard, einen ISO-Standard haben möchte, dann muss man normalerweise vier Jahre in Sitzungen sein und Regelungen achten und Gremien fragen und so weiter.

Dieser Talk geht jetzt um diese Roadmap. Die Roadmap läuft schon. Die ersten Papers sind bereits eingereicht.

Papers deshalb, weil sie versuchen eben Ende 2025 eine ISO-Zertifizierung hinzubekommen.

Diese ISO-Zertifizierung geht normalerweise eben diese vier Jahre.

Man kann aber, wenn man die Paper alle vorher veröffentlicht und alles im Offenen macht,

in der Öffentlichkeit, also die Public Available Specifications macht,

dann kann man es reduzieren auf ein Jahr.

Also trotzdem noch die Gremien, aber es ist praktisch forciert.

Wer hat das Wort ISO noch nie gehört?

Oder DIN? DIN ist halt die deutsche Industrienorm.

Und meistens hängen die sich halt an die internationale ISO einfach noch mit dran.

Es geht bei der aktuellen hier diskutierten Standardisierung um diese beiden Layer, der orange und der graue, also die Grundinformationen.

Was wird abgespeichert? Welche Daten sind ablegbar und werden wie benutzt?

Und eine ganz wichtige Information, die eben bei allen anderen Dateiformaten fehlt,

und das ist praktisch die Magic Source von USD, ist das, was ich vorhin erwähnt habe,

dieses selektive Überschreiben.

Diese Information, dass du eigentlich die ganze Datei lädst,

aber Modifikationen, die für diesen Einsatzzweck gedacht sind, machst.

Und wenn du dieses Paket dann wieder woanders reinlädst,

dann gibt es Regeln, wie ich das dann wieder behandle.

Damit ich solche Sachen machen kann, also wenn ich das nicht mache,

dann habe ich das Problem, wie bei der Spielfilmproduktion vor 15 Jahren oder so,

einer modelliert irgendwas, einer texturiert irgendwas, einer macht Licht und die müssen alle aufeinander warten.

Ja, müssen alle aufeinander warten und wenn der Regisseur sagt, das gefällt mir nicht,

lass uns doch da nochmal einen Henkel dran machen, dann sagen alle, ah scheiße, alles nochmal neu machen,

weil jeder auf den anderen warten muss. Und dieses, das ist bei Industrie und OCRD genau dasselbe.

Ja, wenn ich eine Änderung mache, dann muss ich das komplett durchziehen. Und wenn ich das nicht

mit vernünftigen Regeln mache, dann habe ich halt 25 riesige Dateien und muss dann halt wissen,

dass ich die 24. Version nehme, weil die 25. ist zu neu, das ist noch geheim, das ist für nächstes Jahr.

Und keiner weiß, bei Volkswagen hat es sage und schreibe drei Jahre gedauert,

bis ein für sie wichtiges Dateiformat in die Datenbank reingespeichert werden durfte.

Die IT. Drei Jahre.

So, das muss also geregelt sein. Und da kommt jetzt USD und sagt, wir sind die Ersten, die nicht nur CAD-relevante Informationen,

sondern auch Visualisierungs- und Schönaussehen und Realtime-möglichmachen Informationen haben.

Denn die ganzen CAD-Programme, die sagen, ja, wir machen unseren Job gut, seit 25 Jahren.

Die Software ist doch 20 Jahre alt.

Sieben Masten, sage ich nur. Sieben Masten.

Ja, es wird einfach ausgeweitet, geupdatet.

Auch Farbe, damit es auf dem Bildschirm entweder blau oder rot aussieht.

In Bonbonfarben.

Aber nur damit der CAD-Mann weiß,

ach, das ist jetzt Plastik und das ist Metall.

Aber es sieht nicht aus wie Plastik oder Metall,

sondern lila ist halt Plastik und blö ist Metall.

CAD kommt damit klar.

Aber wenn jetzt irgendeiner kommt und sagt,

wir hätten gerne in der Visualisierungssoftware

die ganzen schönen CAD-Daten,

dann sagen die, oh, das ist zu viel.

Und wenn man aber sagt, ich möchte in der CAD-Welt

fotorealistische Sachen machen können, dann sagen die, das ist nicht unser Job.

Da gibt es eine komplette Industrie, die davon lebt, diese Lücke zu schließen.

Alles nochmal neu zu machen.

Wie? Ihr habt das Lenkrad um 5 cm verschoben?

Toll! Wir kriegen Arbeit. Wir sollen das nochmal neu machen.

Es wird nach Stunden bezahlt.

Es gibt eine komplette Industrie, die nur davon lebt.

und der Mittelstand braucht USD, damit das nicht mehr da ist.

Ja?

NURBS ist schon seit Jahren im Standard drin.

Und das heißt auch Parametrikt hinter den NURBS steht,

das heißt, dass da auch eine Aufbaureihenfolge oder zumindest das Parameteränder sind innerhalb von USD?

Es gibt drei Sachen, die bei USD unterstützt werden im Dateiformat.

Das sind die Polygon-Meshes mit der Unterscheidung, dass es Quads, also Vierecke oder Fünfecke oder Zwanzigecke oder Dreiecke sind.

Bei allen anderen Standards gibt es nur Dreiecke.

Das sieht dann auch grob aus und lässt sich dann nicht mehr schön machen.

CAD Leute und Visualisierer lieben Quads zum Beispiel oder Angons.

Das kann USD abspeichern. USD kann aber gerade für den Animationsbereich sogenannte Subdivision

Surfaces abspeichern. Das hat Pixar als allererstes Open Source gemacht und Apple hat 2017 portiert

und wieder Open ist was zurückgegeben.

Dieses Jahr bringen sie es raus,

weil die Handys alle schnell genug sind,

damit es geht.

Und die Subdivision Surfaces

sind Mitteldingen zwischen Polygon-Meshes

und NURBS.

Und im Dateiformat ist es standardisiert.

Es gibt Gerüchte, dass auch NURBS

bei Nvidia hineinkommen könnten und Subdivision offiziell Apple sagt,

fast jedes Jahr kümmert euch um Subdivision.

CAD Leute, Visualisierer, Subdivision, da geht es hin.

Ja, jetzt machen sie es.

Das ist also im Grundformat drin, im Dateiformat.

Genutzt wird derzeit von den meisten ein Misch-Workflow,

der alles in dreieckige Polymeshes,

drei Tri-Polymeshes hineinpackt.

Das ist so der kleinste gemeinsame Nenner.

Ja, geht aber besser.

Besonders, wenn man es in dieselbe Datei reinspeichern kann.

Und ich war live dabei, vor ein paar Wochen war ein Zoom-Call,

wo eine engagierte Gruppe gesagt hat,

ja, lass uns doch die NURBS mit in GLTF reinspeichern,

damit es Zukunft hat.

Geblockt.

Total geblockt.

Ja.

Die beiden Sachen sind jetzt zwar aufeinander aufbauend, aber sie werden parallel standardisiert.

Weil es ist ja schon seit Jahren abgehangen in der Filmwelt, wird das hier die ganze Zeit schon benutzt.

Sie gleichen dann nochmal ein paar Sachen ab.

Zum Beispiel brauchst du es im Film nicht unbedingt, dass du eine Koordinate weltweit genau, also auf dem Weltglobus genau auf den Zehntel Millimeter machst.

Aber im Geobereich brauchst du diese Information.

Deswegen wird es jetzt in einer höheren Genauigkeit abgespeichert.

Der Ursprung von einem Asset ist jetzt auf der ganzen Welt platzierbar. Früher brauchte man es nicht.

Wenn du es möchtest, ja. Wenn du es möchtest. Die Grundlagen werden damit gelegt.

und eben nicht nur diese Dateninformationen, sondern auch diese speziellen Optimierungsgeschichten,

die es so leistungsfähig machen, weil es bei der Filmproduktion eben darauf ankommt,

dass alle Abteilungen gleichzeitig mit den Daten arbeiten können, ohne sich in die Quere zu kommen.

Das habe ich ja vorhin gesagt, wenn ich alles einzeln wieder abspeichern muss und alles neu machen muss,

dann kommst du nicht weiter und durch usd gibt es diese sichtweisen dass du gleichzeitig arbeiten

kannst am selben projekt an der selben szenen an der same datei diese sachen komme ich gleich

noch mal drauf sie wollen also dass du also diese sachen gibt es auch eines ist jetzt das

besondere das ist diese composition engine dass das war das was ich gerade gesagt hat das ist die

besondere source und die verschiedenen nativen datei formate versuchen den rest abzudecken aber

jeder eben für sich und möglichst nicht open source sondern das ist halt mein mein geheim

Rezept. Das ist meine Geschäftsgrundlage. Und erst durch OpenUSD kommt einer her und sagt,

ja, ich zeige euch, wie es richtig gemacht wird. Diese Besonderheit ist eben, dass ich,

wir beschreiben ein vorhersehbares Verhalten für die Generierung von Layer-Komposition,

sortiert nach der sogenannten LIVPS, das ist eine Abkürzung von vielen Regeln,

so eine sechs Buchstabenregelung.

Die USD-Spezialisten, die Filmleute, die kennen das auswendig,

aber hier ist es jetzt nicht so relevant.

Erst im CRD-Kontext wird das dann richtig effizient.

Die Meinung zu jedem Primitiv auf der Bühne

und die aufgelösten Werte beitragen können und alle Metadaten,

einschließlich der Attributwerte und Beziehungen von Objekten und Prim's untereinander auf der virtuellen Bühne.

Hört sich kompliziert an, ist auch kompliziert, aber das ist eben die magische Soße.

Erst dann wird es richtig effizient.

Das ist jetzt ein Bild, was jetzt nicht mit USD gemacht ist. Das ist eine Blender-Testszene.

Aber ich möchte euch darauf hinweisen, alle Stühle haben exakt dieselbe Textur. Hier ist es dunkel,

hier ist es dunkel, hier ist es dunkel. Die Maserung. Die Dateiformate, die nativen Dateiformate,

also die optimiert sind für das jeweilige Programm. Die können mit sowas umgehen,

wenn ein und dasselbe identisches Objekt ganz oft vorkommt in einer Szene oder in einer Fabrikhalle.

Damit können die umgehen. Die Dateiformate, die dann benutzt werden, um zwischen den verschiedenen

Paketen hin und her zu schieben?

Meistens nicht.

Und auf einmal schickst du dann

aus einem Projekt,

was 20 Stühle hat,

die eigentlich gleich sind,

schickst du die Datei raus

und es kommen 20 Stühle raus,

die zufällig gleich aussehen,

aber es sind 20 mal dieselben Daten.

So wie die Unity-Apps,

die alle auf dem Handy liegen

und eigentlich dasselbe sind,

aber weiß halt keiner, dass das dieselben sind.

Außer es kommt jemand und sagt, das sind wirklich dieselben.

Ja, dann warum nicht gleich?

Und das können eben nur diese nativen Dateiformate oder USD.

Bei der Standardisierung sind sie jetzt schon relativ weit,

weil es ist ja schon 15 Jahre erst mal nur bei Pixar entwickelt worden,

dann wurde es veröffentlicht und USD genannt.

Und mittlerweile sind ganz viele Teams da dran gewesen und haben es immer besser, immer besser, immer besser gemacht.

Und das lässt sich halt schon standardisieren.

Manche Sachen fehlen noch, die werden jetzt gerade hinzugefügt.

Zum Beispiel gab es jetzt diesen März eine in meinen Augen sehr wichtige Ergänzung,

dass du in Dateidatennamen und innerhalb auch mit Umlauten arbeiten kannst oder mit Sonderzeichen.

Ihr kennt das vielleicht, wenn du irgendeine Textdatei von Windows zum Mac oder andersrum

schickst, auf einmal hast du statt Üs und Ess hast du ein Fragezeichen oder irgendwas.

so ein großes A mit einem Kringel drauf, das sollte eigentlich ein Ü sein oder ein Z.

Die CAD-Programme haben ein ähnliches Problem. A, weil sie 25 Jahre alt sind und B, weil sie nur

Windows sind, da haben sie halt auch komische Zeichensätze, alte Zeichensätze. Und wenn ich

dann in Deutschland arbeite, dann hat alles den deutschen Zeichensatz, so wenn ich die Daten

aber austauschen möchte, dann wird aus dem Ü, die Überwurfring, Oberwurfring. Oder das

U geht ganz weg, weil Ü kenne ich nicht, bin amerikanisches Software. Wird einfach wegoptimiert.

das wurde jetzt nachgezogen und damit habe ich gesunde grundlage damit ich auch cd-programme

mit hineinbekommen kann rein und raus das war dieses jahr und jetzt kommt gerade in vorbereitung

die ersten Umbauten sind in USD schon gemacht, dass ich auch in der USD-Datei Animationen so abspeichere,

wie es in einem Animationsprogramm üblich ist.

Dass ich bei der Animation sage, es soll eine leichte Beschleunigung geben und dann eine Abbremsung.

Das ist so das Beschreiben im Animationsprogramm über Baiser-Kurven,

dass ich fein tunen kann, wie steil soll es denn sein.

Und dann kann ich auch noch sagen, der soll da bleiben, aber der soll jetzt ein bisschen flacher oder steiler sein.

Das kann ich auch noch machen.

Und aktuell in GLTF-Dateien und aktuell in USD-Dateien wird daraus dann Folgendes gemacht,

dass für jedes Bild ein Keyframe gesetzt wird.

Und wenn du das nachher nochmal ändern möchtest,

oh, ein bisschen viel Arbeit.

Du musst wieder diese Kurve nachbauen, damit du sie nochmal änderst und dann wieder neu abspeichern.

Das bringen sie jetzt rein, dass sie das auch mit abspeichern können und dass die Programme das dann auch lesen und wieder schreiben können.

Für den Filmbereich war das bisher noch nicht so nötig, weil meistens geht es ja ums Rendern.

Und die Animation ist halt in dem Programm schon noch mit drin.

Das bringen sie gerade rein.

Und Pixar hat eben vor vielen Jahren das USD herausoperiert.

seinem eigenen hausinternen Animationsprogramm, das heißt Presto,

und eigenständig gemacht und open source gemacht.

Und jetzt isolieren Sie das nächste große Datenpaket heraus.

Das ist Ihre OpenExec.

Das ist eine Datenveränderungsengine, sag ich mal so,

was sie benutzen um für simulationen für haare eben aber auch für crowd simulation zu benutzen

und das bringen sie jetzt auch gerade da wieder mit hinein und in die standardisierung vielleicht

noch nicht bis ende 25 aber doch da kommen noch spannende sachen bei raus was dabei nicht heraus

kommen wird, ist, dass man das auch als Game-Engine-Logik benutzen kann. Das hatten einige gehofft.

Das wird ein Bauspein dafür sein, aber der Zahn wurde mir gezogen von Nick Pocino, als ich ihn

gefragt habe kann das dann vielleicht das auch aber ganz wichtig dass es massiv parallel arbeiten

kann auf ganz viele punkte von einem mesh damit du interaktiv sachen optimieren kannst also wenn man

sich mal das video anschaut wie sie ein character der fünf millionen haare hat ja und jedes haar

hat drei kontrollpunkte drauf und das wird komplett in realtime animiert mit haaren auf

einer high end grafikkarte eingebaut in den animatoren rechner und das kann eben nur zur

laufzeit so schnell passieren wenn du massiv parallele algorithmen hast deswegen cd programme

wollen keine haare haben aber sie können es bald so wer mehr informationen haben möchte beim googeln

nicht usd sondern open boost die eingeben und morgen leider bringt apple talk aus developer

video wo sie die neuesten sachen für osd und mit mithilie x mithilie x ist dieser

iron man geschichte das ist der standard der damit der look überall gleich ist ja

die beiden welten kommen zusammen mit hügel x informationen kommen nach nach osd rein und

bringen halt da ein gemeinsamer standard auch für alle programme rein adobe hat es gerade noch so

geschafft zusammen mit autodesk das open pba heraus zu bringen open pba ist ein auf material

x basierender neuer standard das mit um die meisten materialien super gut beschreiben kannst

sehr interessant und das kommt jetzt auch nach nach reality kit 4 das heißt all die sachen die

Die neuesten Sachen waren jetzt alle in Vision OS schon drin.

Wir haben es jetzt gesehen.

Aber das wird rückportiert auf dem Mac, aufs iPad und iPhone.

Und das ist spannend, weil die Lücke war jetzt die ganze Zeit da,

zwischen den Realtime arbeitenden alten Geräten, sag ich mal so.

iPhones laufen ja auch noch mit, wenn sie sieben Jahre alt sind,

mit dem aktuellen Betriebssystem.

aber die neuesten Sachen, die haben Sie jetzt erstmal nur auf die Vision Pro gebracht.

Und das putieren Sie jetzt zurück. Das wird spannend noch.

→ Vortrags-Mitschnitt: Die AOUSD-Roadmap (ca. 35 Min.)

Microsoft, Google & OpenUSD:

Strategischer Kurswechsel

Über fast ein Jahrzehnt hinweg setzten Microsoft und Google konsequent auf glTF (*.glb) als deren alternativen 3D-Standard. glTF erfüllte einen klaren Zweck: effiziente Auslieferung von 3D-Inhalten vor allem für Webseiten mit kleinen 3D-Elementen und Browser-AR-Lösungen auf Android-Smartphones. Für viele Unternehmensanwendungen blieb jedoch eine Lücke.

glTF ist auf (mobile) Darstellung optimiert, nicht auf strukturierte Weiterverarbeitung, Versionierung oder paralleles Arbeiten an komplexen 3D-Daten. Eine nahtlose Integration von 3D-Inhalten in alltägliche Arbeitsumgebungen – etwa Präsentationen, Dokumente oder Kollaborationstools – war damit nur eingeschränkt möglich. Gerade im Büroalltag vieler Unternehmen fehlte damit eine Brücke zwischen 3D-Daten und klassischen Produktivitätswerkzeugen.

2025: Beitritt zur AOUSD und

Öffnung Richtung OpenUSD

Im Jahr 2025 vollzogen Microsoft und Google einen bemerkenswerten Schritt: Beide Unternehmen traten der Alliance for OpenUSD (AOUSD) bei und kündigten an, OpenUSD in ihren Systemen zu unterstützen. Dieser Schritt ist weniger technisch als strategisch zu verstehen.

OpenUSD adressiert genau die Punkte, die glTF bewusst offen lässt:

- strukturierte, versionierbare 3D-Daten

- paralleles Arbeiten mehrerer Teams

- Wiederverwendbarkeit über unterschiedliche Kontexte hinweg

Persönliche Einschätzung von Gerhard Schröder,

Geschäftsführer vom viSales:

"Über viele Jahre hinweg setzte Google konsequent auf den glTF-Anwendungsfall „AR im Browser“. Das war – und ist – ein klarer E-Commerce-Use Case: niedrigschwelliger Zugang, keine App-Installation, plattformübergreifend nutzbar. Ein sinnvoller und gut begründeter Ansatz.

Parallel dazu verfolgte Apple eine andere Strategie. Während Google AR primär über den Browser (Chrome) und damit bewusst betriebssystemunabhängig dachte, integrierte Apple AR tief in das Betriebssystem iOS. Auch das ist ein konsistenter Ansatz – mit dem Fokus auf Systemintegration statt maximaler Reichweite.

Beide Wege hatten ihre Berechtigung.

Dass Google und Microsoft nun dennoch den OpenUSD-Weg mitgehen, lässt sich als Signal lesen, dass sich die Industrie zunehmend auf eine gemeinsame strukturelle Basis für 3D-Daten verständigt – jenseits einzelner Ausspielkanäle wie Browser oder App.

Welche Auswirkungen dieser Strategiewechsel auf das gerade entstehende Android-XR-Ökosystem von Google haben wird, ist derzeit offen. Klar ist jedoch: OpenUSD verschiebt den Fokus weg vom einzelnen Ausgabekanal hin zu einer gemeinsamen, langfristig nutzbaren Datenstruktur.

Und genau darin liegt aus meiner Sicht die strategische Bedeutung für Unternehmen!"

Solange OpenUSD als weiteres Austauschformat behandelt wird, bleibt sein Nutzen begrenzt. Sein eigentlicher Wert liegt nicht im Export, sondern darin, 3D wie ein strategisches Medium zu behandeln – mit einer verantworteten Masterdatei statt paralleler Einzelversionen.

Dieser Text entstand im Rahmen meiner Vorbereitungen für eine Seite zum Thema "OpenUSD für Entscheider" und wird in Zukunft auf der neuen Seite unter "Weitere Infos" als Longread angeboten werden.

Wer mehr zu meinen (nicht so technischen Gedanken) zum Thema "Visuelles im Sales" erfahren möchte, der sollte meinen monatlichen Newsletter "Visual Sales" abonnieren.

Nächste Woche gibt es dort die offizielle Ausgabe 1/26.

Einstieg in AR & USDZ — mit Unterstützung.

Wir begleiten Unternehmen vom ersten USDZ-Modell bis zum eingebetteten AR-Erlebnis im Vertrieb. Das erste Gespräch dauert 30 Minuten. Ohne Pitch, ohne Vorbereitungspflicht. Rheingas, Somfy und Carl Hamm haben mit einem Produkt begonnen.

Das fragen Entscheider

Wer hat OpenUSD entwickelt und wann?

OpenUSD wurde 2015 von Pixar erstmals öffentlich vorgestellt und 2016 als Open-Source-Projekt freigegeben. Ziel war es, komplexe Filmszenen über viele Abteilungen hinweg konsistent zu organisieren. 2023 wurde das Projekt in die Alliance for OpenUSD (AOUSD) überführt und unter dem Dach der Linux Foundation als neutraler Industriestandard weiterentwickelt.

Was ist die Alliance for OpenUSD (AOUSD) und wer gehört dazu?

Die AOUSD wurde 2023 gegründet, um OpenUSD von einzelnen Unternehmensinteressen zu lösen und als branchenneutralen Standard zu etablieren. Mitglieder sind u. a. Siemens, BMW, Mercedes-Benz, Apple, NVIDIA, Microsoft und Google. Die Core-Spezifikation 1.0 wurde am 17.12.2025 veröffentlicht; eine Weiterentwicklung zum IEEE-Standard ist für 2026 geplant.

Was ist der Unterschied zwischen OpenUSD und glTF?

glTF (*.glb) ist auf performante Darstellung im Browser und auf mobilen Geräten optimiert – ideal für E-Commerce-AR und Web-Visualisierungen. OpenUSD ist für strukturierte Weiterverarbeitung, Versionierung und paralleles Arbeiten an komplexen 3D-Daten ausgelegt. Das Metaverse Standards Forum legte USDZ als übergeordnetes Masterformat fest, aus dem glTF abgeleitet werden kann.

Warum sind Microsoft und Google 2025 zu OpenUSD gewechselt?

Beide Unternehmen traten 2025 der AOUSD bei. glTF adressiert den Browser-AR-Use-Case gut, lässt aber strukturierte Weiterverarbeitung, Versionierung und paralleles Arbeiten offen. OpenUSD ermöglicht die Integration von 3D-Inhalten in Produktivitätswerkzeuge wie Präsentationen und Dokumente – ein Anwendungsbereich, der mit glTF nur eingeschränkt umsetzbar war.

Warum ist OpenUSD strategisch und nicht nur technisch relevant?

OpenUSD löst das eigentliche Problem moderner 3D-Workflows: Dieselben CAD-Daten werden für Website, Video, AR und Simulation immer wieder neu aufbereitet – mit steigenden Kosten und inkonsistenten Ergebnissen. Als gemeinsame Datenstruktur macht OpenUSD diesen permanenten Neubau überflüssig. Sein Wert liegt nicht im Export, sondern darin, 3D als strategisches Medium mit einer gemeinsamen Masterdatei zu behandeln.

Die Geschichte von OpenUSD zeigt, warum der Standard heute strategisch relevant ist. Was das konkret für Unternehmen bedeutet, steht in der Übersicht: OpenUSD für Entscheider